Så stärker du säkerhet i språkhantering för medicin och juridik

- för 1 dag sedan

- 7 min läsning

En enda feltolkad mening i ett medicinskt journaldokument eller ett juridiskt avtal kan utlösa ett patientskadeärende, ett avtalsbrott eller en regulatorisk sanktion. Det är inte en hypotetisk risk utan en realitet som beslutsfattare i Europas medicinska och juridiska organisationer måste hantera aktivt 2026. AI-system för språkhantering klassas som högrisk enligt EU AI Act, vilket innebär att kraven på säkerhet, transparens och mänsklig kontroll nu är lagstadgade. Den här artikeln ger dig en strukturerad genomgång av riskerna, regelverken och de konkreta åtgärder som krävs för att din organisation ska hålla sig på rätt sida av lagen, utan att offra effektivitet.

Innehållsförteckning

Viktiga Insikter

Punkt | Detaljer |

EU-krav styr AI-språk | Alla organisationer måste följa EU AI Act och GDPR för laglig språkhantering. |

Flera hot mot datan | Prompt injection, hallucinationer och bias är vanligast – kräver aktivt skydd. |

Manuell och automatisk kontroll | Säkerhetsrutiner kräver både mänsklig översyn och smarta AI-verktyg. |

Bästa praxis ger compliance | Kontinuerlig träning, tydliga rutiner och robust teknik minskar riskerna och förbättrar kvaliteten. |

Säkerhetsrisker med AI i språkhantering: nuläge och nya lagkrav

Språkhantering med AI befinner sig i ett regulatoriskt skifte. Det räcker inte längre att välja ett verktyg som producerar begriplig text. Organisationer inom medicin och juridik måste nu bevisa att deras AI-system uppfyller specifika krav på robusthet, spårbarhet och mänsklig insyn.

EU AI Act klassificerar AI-system för medicinsk diagnostik, juridiskt beslutsfattande och avancerad språkbearbetning i högriskkategorin. Det innebär registreringskrav, dokumentationsskyldigheter och krav på kontinuerlig riskbedömning. Organisationer som inte anpassar sig riskerar böter och förbud mot att använda systemen.

De vanligaste säkerhetsriskerna med AI-baserade språkverktyg är välkända men underskattas ofta i praktiken. LLM-system exponerar språkdata för risker som informationsläckage, prompt injection, hallucinationer och systematisk bias. I en juridisk kontext kan en hallucination, det vill säga att modellen hittar på fakta som inte finns, leda till att ett avtal innehåller felaktiga hänvisningar till lagrum. I en medicinsk kontext kan bias i terminologin ge snedvridna diagnosbeskrivningar.

För att ge en tydlig bild av skillnaderna mellan olika teknologinivåer:

Teknologi | Kontexthantering | Terminologikontroll | Lämplighet för reglerad sektor |

MT (legacy) | Svag, literal | Ingen | Låg |

NMT (publik SaaS) | Måttlig | Variabel | Begränsad utan styrning |

Proprietär LLM med AI+HUMAN | Stark, dokumentnivå | Enforced via TB/TM | Hög med rätt QA-process |

De specifika hoten mot medicinska och juridiska data inkluderar:

Informationsläckage via publika molntjänster utan dataisolering

Prompt injection där angripare manipulerar AI-systemets instruktioner

Hallucinationer med påhittad terminologi eller felaktiga rättsliga referenser

Bias som snedvrider översättningar av känsliga patientuppgifter

Otillräcklig autentisering som ger obehörig åtkomst till känsliga dokument

För en djupare förståelse av LLM-roller vid språktjänster och hur språkteknologi för högrisksektorer fungerar i praktiken är det viktigt att förstå att valet av teknologiplattform direkt påverkar din organisations riskprofil. EDPB:s riktlinjer för AI-privacy ger en konkret karta över vilka mitigationsåtgärder som rekommenderas.

Så fungerar säker språkhantering enligt EU-reglerna

Att följa EU:s regelverk för AI-driven språkhantering handlar om att omsätta abstrakta krav i konkreta processer. Beslutsfattare behöver förstå exakt vad som krävs, inte bara i teorin utan i det dagliga arbetet.

GDPR:s princip om privacy by design innebär att dataskydd ska vara inbyggt i systemet från start, inte tillagt i efterhand. För språkhantering betyder det att känsliga uppgifter ska minimeras, pseudonymiseras eller krypteras redan innan de når AI-systemet. Det är inte en teknisk detalj utan ett ledningsbeslut.

Högrisk-AI måste registreras i EU:s databas, följas upp kontinuerligt och genomgå obligatorisk mänsklig tillsyn. Det innebär att din organisation behöver dokumenterade processer för hur AI-genererade översättningar granskas, godkänns och arkiveras.

För att bygga en compliant process rekommenderar vi följande steg:

Kartlägg dataflöden och identifiera var känsliga uppgifter behandlas i översättningsprocessen

Välj EU-hostad infrastruktur med verifierad ISO 27001-certifiering och ingen beroende av publika molntjänster

Implementera mänsklig granskning av alla AI-genererade texter i reglerade sammanhang

Upprätta incidentrapporteringsrutiner enligt GDPR:s 72-timmarskrav

Dokumentera riskbedömningar (FRIA, Fundamental Rights Impact Assessment) för högrisk-AI-system

Utbilda personal i AI-kompetens och identifiering av hallucinationer

MSB och CERT-SE betonar vikten av robust autentisering och säker hantering av AI/ML/LLM-system i känsliga tillämpningar, inklusive flerspråkig databehandling. Det är råd som direkt är tillämpliga på medicinsk och juridisk språkhantering.

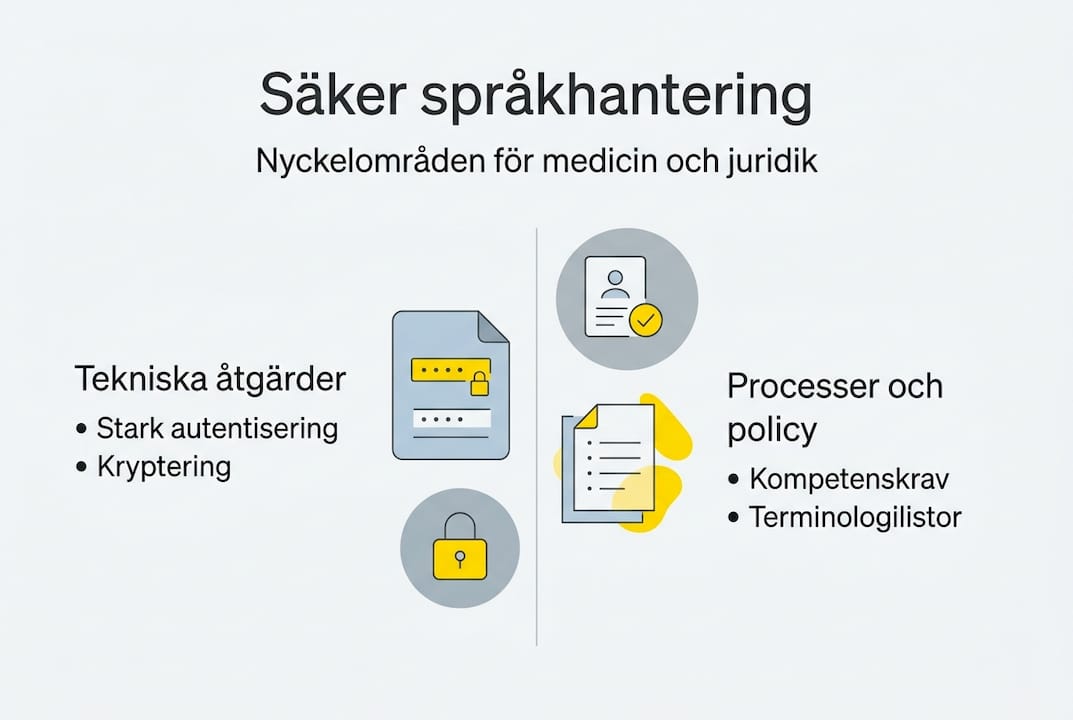

Språkpolicy är ett underskattat styrmedel. Krav på specifika kompetensnivåer hos granskare, tydliga terminologilistor och definierade stilguider minskar variansen i AI-output och gör det lättare att identifiera fel. En väldefinierad terminologibas är inte bara en kvalitetsfråga utan en säkerhetsfråga.

Proffstips: Kräv att din leverantör kan visa upp ett Data Processing Agreement (DPA) och Business Associate Agreement (BAA) som specifikt täcker AI-genererad språkhantering. Utan dessa dokument saknar du juridiskt skydd vid ett dataintrång. Läs mer om hur compliant språk-AI fungerar i praktiken.

Vanliga hot och misstag vid AI-driven översättning

Trots tydliga regelverk fastnar många organisationer i fallgropar. De flesta misstagen beror inte på ond vilja utan på bristande förståelse för hur AI-system faktiskt beter sig under verkliga förhållanden.

Det vanligaste och mest underskattade hotet är prompt injection. En angripare kan bädda in dolda instruktioner i ett dokument som skickas för översättning, vilket får AI-systemet att agera på dessa instruktioner i stället för att översätta texten. I ett medicinskt sammanhang kan detta leda till att känsliga patientuppgifter exponeras i outputen.

AI-baserade språkverktyg riskerar prompt injection, systematisk bias och modellhallucinationer, särskilt i känsliga tillämpningar som medicinska journaler och juridiska kontrakt. Det är inte en teoretisk risk utan ett dokumenterat mönster.

“En hallucination i ett juridiskt dokument är inte ett tekniskt fel. Det är ett potentiellt avtalsbrott eller en felaktig rättslig bedömning med verkliga konsekvenser för klienter och patienter.”

De kritiska misstagen att undvika:

Att använda publika NMT-verktyg för känsliga dokument utan dataisoleringsavtal

Att hoppa över mänsklig granskning med argumentet att AI-kvaliteten är tillräcklig

Att sakna bias-kontroll i terminologilistor och träningsdata

Att inte testa för prompt injection i ingångsdokument från externa parter

Att förlita sig på en enda granskare utan strukturerad QA-process

Bias är ett särskilt svårt problem eftersom det ofta är osynligt. En AI-modell tränad på ojämnt fördelad data kan konsekvent använda terminologi som är korrekt i ett sammanhang men missvisande i ett annat. I medicinska texter kan detta påverka hur symtom beskrivs beroende på patientens bakgrund.

Proffstips: Inför regelbundna stickprovskontroller av AI-genererade översättningar mot godkänd terminologibas. Det tar 30 minuter per vecka och kan avslöja systematiska fel innan de når kritiska dokument. Se mer om AI-översättningssäkerhet och specifika krav för säker juridisk översättning.

Best practice: Så skapar du säker språkhantering för 2025 och framåt

Nu när vi vet vad som kan gå fel återstår frågan: hur gör du rätt, inte bara för att undvika risk, utan för att garantera trygg språkhantering med framtiden i sikte?

Bästa praxis innefattar FRIA-implementation, AI-kompetensutbildning för all berörd personal, kontinuerlig övervakning av systemets output och strukturerade eftermarknadskontroller. Det är inte en engångsinsats utan ett löpande arbete.

Här är de åtgärder som ger störst effekt:

Välj AI-system byggda för GDPR och AI Act med EU-hostad infrastruktur och verifierad ISO 27001-certifiering

Kräv BAA och DPA från alla leverantörer som hanterar personuppgifter i översättningsprocessen

Implementera Translation Memories och Term Bases för att styra AI-output och säkerställa terminologikonsistens

Genomför FRIA (Fundamental Rights Impact Assessment) för alla högrisk-AI-system i din organisation

Utbilda personal i AI-kompetens, hallucineringsidentifiering och säker hantering av AI-output

Sätt upp kontinuerlig övervakning med definierade tröskelvärden för kvalitetsavvikelser

Testa incidentrespons minst en gång per år med simulerade dataintrång

Valet av leverantör är kritiskt. En leverantör med proprietär EU-hostad infrastruktur, certifierad enligt ISO 27001 och ISO 17100, med dokumenterad AI+HUMAN-process eliminerar en stor del av riskerna. Det är inte dyrare i längden. Kostnaden för ett dataintrång eller en regulatorisk sanktion överstiger vida kostnaden för ett robust system.

Proffstips: Integrera språkhanteringssäkerhet i din organisations övergripande riskhanteringsramverk, inte som en IT-fråga utan som en verksamhetskritisk process. Läs mer om ett säkert AI-translation workflow och använd en checklista för AI+människa-översättningskvalitet för att strukturera arbetet.

Vår syn: trygg översättning kräver mer än teknik och lag – så undviker du blinda fläckar

Efter 25 år i branschen ser vi ett återkommande mönster: organisationer som investerar i rätt teknik och uppfyller alla formella krav ändå råkar ut för allvarliga fel. Varför? För att de blinda fläckarna sällan finns i systemen utan i gränssnitten mellan system, människa och process.

Den verkliga risken är inte att AI-systemet är dåligt. Det är att granskaren är överbelastad, att terminologibasen inte uppdaterats på sex månader, eller att IT-avdelningen och juridikteamet aldrig pratat med varandra om vad som faktiskt händer med data i översättningsflödet.

Robust säkerhet i språkhantering kräver redundans på tre nivåer: teknisk, processbaserad och kompetensbaserad. Teknik kan fela. Processer kan ha luckor. Kompetens kan vara ojämnt fördelad. Det är kombinationen av alla tre som ger verklig trygghet.

Bygg en kontinuerlig dialog mellan IT, juridik, språkproffs och vårdpersonal. Inte ett möte per år utan ett levande samarbete. Läs mer om hur övervakad AI för översättning fungerar som en del av detta.

Så hjälper AD VERBUM dig till säker språkhantering

Med insikt om risker och lösningar kan du nu ta nästa steg mot 360° säker språkhantering, och här är hur vi hjälper dig.

AD VERBUM erbjuder professionell översättning och tolkning för medicinsk och juridisk sektor, fullt anpassad till EU AI Act, GDPR och MDR. Vår proprietära LangOps System körs på EU-hostade servrar utan beroende av publika molntjänster. Med 3 500 plus ämnesexpertlinguister och ett 100-procentigt AI+HUMAN-hybridflöde levererar vi 3 till 5 gånger snabbare än traditionella processer, utan att kompromissa med säkerhet eller compliance. Läs om vårt arbetssätt eller utforska vår AI+människa-översättning och kontakta oss för en kostnadsfri rådgivning.

Vanliga frågor om säker språkhantering

Vilka AI-verktyg är godkända för språkhantering enligt EU AI Act 2025?

Endast högriskklassade AI-system som uppfyller EU:s krav på transparens, robusthet och registrering får användas i regulatoriskt styrda sammanhang. Verktyg utan dokumenterad riskbedömning och mänsklig tillsyn uppfyller inte kraven.

Hur undviker man informationsläckage vid AI-baserad översättning?

Använd privata, EU-hostade LLM-system med stark autentisering. Dataminimering och kryptering är de mest effektiva tekniska skyddsåtgärderna mot läckage av känsliga uppgifter.

Vilka är de vanligaste riskerna med AI i språkhantering för medicinska och juridiska organisationer?

Prompt injection, hallucinationer och bias är de mest kritiska hoten enligt aktuell forskning. Dataläckage via publika molntjänster är ett ytterligare allvarligt hot.

Vad innebär mänsklig översyn inom regulatorisk AI-översättning?

Det innebär att AI:s översättning alltid granskas och godkänns av kompetent, utbildad personal före leverans. Ingen AI-genererad text i ett högrisksammanhang ska nå slutanvändaren utan denna kontroll.

Rekommendation