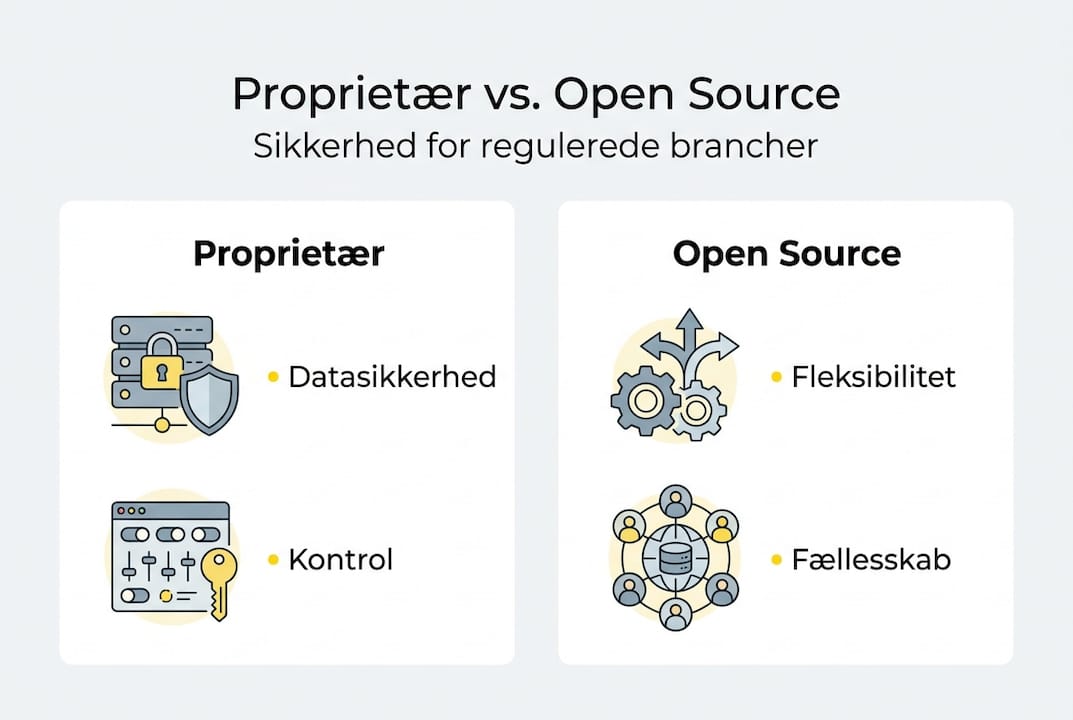

Proprietær AI sprogmodel: Sikkerhed for regulerede industrier

- for 4 dage siden

- 7 min læsning

Proprietære AI-sprogmodeller er lukket, kontrollerede løsninger, som sikrer datasuverænitet og compliance.

De reducerer hallucinationer og øger terminologikontrol, hvilket er afgørende i regulerede industrier.

Valget mellem proprietær, open source eller hybrid påvirker både sikkerhed, omkostninger og regulatorisk krav.

Mange virksomheder antager, at alle AI-sprogmodeller er skabt lige. Sandheden er en anden. For virksomheder i medicin, jura, finans og fremstilling kan valget af AI-model have direkte konsekvenser for compliance, datasikkerhed og dokumentpræcision. En fejloversættelse i en klinisk rapport eller en patentansøgning er ikke blot en sproglig fejl, det er en juridisk og regulatorisk risiko. Denne guide forklarer præcis, hvad en proprietær AI sprogmodel er, hvordan den adskiller sig teknisk fra open source alternativer, og hvorfor valget er afgørende for virksomheder med høje krav til sikkerhed.

Indholdsfortegnelse

Vigtigste Pointer

Punkt | Detaljer |

Proprietær AI er lukket og sikret | En proprietær AI sprogmodel ejes af en virksomhed og beskytter data gennem lukkede systemer. |

Bedre compliance og færre fejl | De bruges i medicin, jura og finans fordi de minimerer fejl og opfylder reguleringskrav. |

Performance for specifikke brancher | Branchespecialiserede proprietære modeller leverer højere nøjagtighed end generiske AI-løsninger. |

Vendor lock-in vs fleksibilitet | Til gengæld betyder proprietær AI ofte låste vilkår og omkostninger, mens open source kræver infrastruktur. |

Hvad er en proprietær AI sprogmodel?

En proprietær AI sprogmodel er en lukket, kommercielt ejet stor sprogmodel (LLM), hvor modelens vægte og træningsdata ikke frigives offentligt. Det betyder, at kun den virksomhed, der ejer modellen, kontrollerer adgang, brug og videreudvikling. Modsat open source modeller, som kan downloades og tilpasses frit af alle, er proprietære modeller kun tilgængelige via leverandørens egne platforme eller API’er.

Forskellen er ikke kun teknisk. Den er strategisk. Ejerskab over modellen betyder ejerskab over sikkerhedslaget, dataflowet og den løbende opdatering af modellen.

Kendte eksempler på proprietære sprogmodeller inkluderer ChatGPT fra OpenAI, Claude fra Anthropic og Gemini fra Google. Disse modeller er bygget på massive, ikke-offentliggjorte datasæt og er underlagt strenge kommercielle vilkår.

For regulerede industrier giver denne lukkede struktur en række konkrete fordele:

Kontrolleret adgang: Kun autoriserede brugere og systemer kan tilgå modellen via sikrede API’er.

Dataisolering: Dine dokumenter og data behandles ikke på delte, offentlige servere.

Auditspor: Leverandøren kan dokumentere præcist, hvad der er sket med dine data.

Terminologikontrol: Modellen kan instrueres til at følge din virksomheds godkendte ordlister og stilguider.

SLA-forpligtelser: Kommercielle leverandører tilbyder juridisk bindende serviceniveauaftaler.

Open source modeller som LLaMA eller Mistral kan tilbyde fleksibilitet og lavere omkostninger, men de kræver, at din virksomhed selv bygger og vedligeholder den sikre infrastruktur. Det er en investering, mange undervurderer.

“For virksomheder i regulerede industrier er kontrollen over modellen ikke en fordel, det er et krav. Manglende kontrol er en compliance-risiko i sig selv.”

Forståelsen af LLM og compliance er første skridt mod at træffe det rigtige teknologivalg for din organisation.

Hvordan fungerer proprietære sprogmodeller teknisk?

Nu hvor vi kender definitionen, er det vigtigt at forstå, hvordan teknologien bag fungerer i praksis.

Proprietære modeller trænes på massive datasæt med reinforcement learning og supervised fine-tuning for at opnå høj præcision. Det betyder, at modellen ikke blot lærer at forudsige det næste ord, den læres at producere output, der er korrekt, kontekstuelt præcist og i overensstemmelse med menneskelig vurdering.

Sådan fungerer en typisk proprietær sprogmodel i en reguleret kontekst:

Datainput: Dokumentet sendes via en krypteret API-forbindelse til leverandørens private cloud.

Terminologifiltrering: Modellen tjekker input mod din virksomheds godkendte termbaser og oversættelsesminder.

LLM-generering: Modellen producerer output baseret på kontekst, instruktioner og domænespecifik træning.

Sikkerhedslag: Output valideres mod interne regler for at undgå hallucinationer og terminologifejl.

Levering: Det validerede output returneres via krypteret kanal, uden at data lagres på delte servere.

Et konkret eksempel er Behavox AI, der anvender en proprietær LLM til compliance-overvågning i finanssektoren. Modellen er specifikt trænet til at forstå regulatorisk sprog og identificere risici i kommunikation, noget en generisk model ikke kan gøre pålideligt.

Teknologi | Træningsdata | Sikkerhedslag | Terminologikontrol |

Generisk NMT | Offentligt internet | Ingen | Ingen |

Open source LLM | Varierer | Selvbygget | Begrænset |

Proprietær LLM | Proprietær + domæne | Integreret | Fuld |

Professionelt tip: Spørg altid din AI-leverandør, om modellen er trænet på offentlige data fra internettet. Hvis svaret er ja, og du arbejder med fortrolige dokumenter, bør du overveje en proprietær løsning med isoleret databehandling.

Den tekniske arkitektur bag et sikkert AI+HUMAN workflow kombinerer netop denne type proprietær model med menneskelig fagekspertise, hvilket er afgørende for AI-sikkerhed i branchen.

Fordele ved proprietære sprogmodeller for regulerede industrier

Med en forståelse for teknologien kan vi nu vurdere, hvorfor disse modeller er førstevalget for virksomheder med ekstraordinære krav til sikkerhed.

Proprietære modeller foretrækkes for compliance, datasuverænitet og minimering af hallucinationer. Det er ikke markedsføring, det er en konsekvens af, hvordan modellerne er bygget og kontrolleret.

I medicin, jura og finans er konsekvenserne af fejl asymmetriske. En fejl koster langt mere end den tid, det tog at undgå den. Her er de konkrete fordele:

Datasuverænitet: Dine patientjournaler, kontrakter og finansielle rapporter forlader aldrig din leverandørs sikrede, private cloud.

Auditspor: Proprietære systemer logger præcist, hvem der har tilgået hvad og hvornår, et krav under GDPR og mange sektorspecifikke reguleringer.

Terminologikonsistens: Modellen kan tvinges til at bruge din virksomheds godkendte terminologi på tværs af tusindvis af sider, noget offentlige NMT-værktøjer ikke kan garantere.

Reducerede hallucinationer: Domænespecifik træning og terminologifiltrering reducerer risikoen for, at modellen opfinder fakta eller ændrer kritiske negationer.

SLA og ansvar: Kommercielle leverandører påtager sig juridisk ansvar via serviceniveauaftaler.

Et stærkt eksempel er Corti Symphony, der opnår 25% højere præcision end generiske OpenAI-modeller i medicinsk kodning. Det er ikke en marginal forskel, det er forskellen mellem korrekt og forkert diagnose.

Kriterium | Proprietær LLM | Open source LLM |

Datasuverænitet | Høj | Afhænger af infrastruktur |

Hallucinationsrisiko | Lav (domænetrænet) | Moderat til høj |

Auditspor | Integreret | Selvbygget |

Terminologikontrol | Fuld | Begrænset |

Compliance-dokumentation | Leverandøransvar | Eget ansvar |

Forståelsen af datafortrolighed i sprogteknologi og principperne bag datasikker oversættelse er ikke valgfrie emner for compliance-ansvarlige. De er kernen i enhver ansvarlig AI-strategi.

Nuancer, udfordringer og best practices ved valg af AI sprogmodel

Men selv de bedste teknologier har deres nuancer og udfordringer, som enhver beslutningstager bør kende.

Proprietær AI giver høj performance og brugervenlighed, men medfører vendor lock-in og per-token-omkostninger. Open source er bedre for privathed, men kræver betydelig intern infrastruktur. Det er ikke en simpel beslutning.

De vigtigste udfordringer ved proprietære modeller:

Vendor lock-in: Hvis leverandøren ændrer vilkår, priser eller lukker ned, er din integration sårbar.

Omkostningsstruktur: Per-token-prissætning kan blive dyr ved høje volumener.

Begrænset transparens: Du kan ikke inspicere modelens indre, hvilket kan gøre det sværere at forklare beslutninger over for regulatorer.

Afhængighed af leverandørens roadmap: Funktioner og opdateringer sker på leverandørens præmisser.

Hybridmodeller, der kombinerer en proprietær kerne med open source komponenter til specifikke opgaver, er en voksende trend. De kan give det bedste fra begge verdener, men kræver teknisk modenhed at implementere korrekt.

EU AI Act kræver robusthed for generelle AI-modeller (GPAI), og proprietære leverandører tilbyder typisk SLA’er og auditlogs, der letter compliance-dokumentationen. Det er en konkret fordel i en regulatorisk kontekst, hvor du skal kunne bevise, at dit system fungerer korrekt.

“Valget af AI-model er ikke et IT-spørgsmål alene. Det er et compliance-spørgsmål, et juridisk spørgsmål og et spørgsmål om virksomhedens risikoprofil.”

Professionelt tip: Bed altid om en databehandleraftale (DPA) og en sikkerhedsdokumentation fra din AI-leverandør, inden du integrerer modellen i arbejdsgange med fortrolige dokumenter. Manglen på disse dokumenter er i sig selv et rødt flag.

For at forstå de fulde fordele ved AI-baseret oversættelse og implementere en AI+HUMAN løsning korrekt, anbefaler vi at starte med en grundig vurdering af din virksomheds specifikke risikoniveau og regulatoriske forpligtelser. En sammenligning af LLM-typer kan hjælpe med at kvalificere beslutningen yderligere.

Når sikkerhed og domæneforståelse er nøglen: Vores erfaring

Vi ser det gentagne gange: Virksomheder vælger en generisk AI-løsning baseret på teknologiens overordnede imponerende resultater, og opdager derefter, at den ikke forstår deres specifikke fagterminologi. En model, der er fremragende til generel tekst, kan fejle fundamentalt på et medicinsk regulativt dokument eller en juridisk kontrakt med specialiseret sprogbrug.

Compliance handler ikke kun om teknologi. Det handler om domænesprog, løbende tilpasning og menneskelig ansvarlighed. Den fejl, mange begår, er at overvurdere en generisk models evne til at håndtere branchespecifik dokumentation uden specialiseret træning og menneskelig kontrol.

Vores erfaring viser, at den virkelige forskel opstår, når proprietær AI kombineres med fageksperter, der forstår både sproget og branchen. Det er ikke en teknologisk luksus, det er en operationel nødvendighed. En grundig oversættelsesproces for sikkerhed er det, der adskiller acceptable resultater fra resultater, du kan stå juridisk og regulatorisk inde for.

Tag næste skridt mod sikre AI-drevne oversættelser

Efter denne gennemgang er du bedre rustet til at vælge en løsning, der matcher din branches krav. Valget af den rigtige AI sprogmodel er kun første skridt. Det næste er at sikre, at modellen er integreret i en arbejdsgang, der kombinerer teknologisk præcision med menneskelig fagekspertise.

AD VERBUM tilbyder netop denne kombination. Vores proprietære LLM-baserede AI er hostet på EU-servere, ISO 27001-certificeret og integreret i et AI+HUMAN workflow med over 3.500 fageksperter. Resultatet er professionel oversættelse, der lever op til de strengeste krav i medicin, jura, finans og fremstilling. Udforsk vores AI-drevne oversættelsesløsning og kontakt os for at drøfte din specifikke situation.

Ofte stillede spørgsmål

Hvordan adskiller proprietære AI sprogmodeller sig fra open source modeller?

Proprietære og open source modeller adskiller sig primært på ejerskab og kontrol. Proprietære er lukkede, kommercielt ejede og tilbydes kun via leverandørens platform med ekstra sikkerhedslag, mens open source kan bruges og tilpasses frit, men kræver, at din virksomhed selv bygger den sikre infrastruktur.

Hvorfor er proprietære sprogmodeller bedst for medicin, jura og finans?

Behavox og lignende løsninger til regulerede brancher dokumenterer, at proprietære modeller sikrer compliance, datasuverænitet og har markant lavere risiko for fejl og hallucinationer, hvilket er afgørende i miljøer, hvor en enkelt fejl kan have juridiske eller medicinske konsekvenser.

Reducerer proprietære modeller virkelig hallucinationer?

Ja. Brancherettede modeller har lavere hallucinationsrate takket være domænespecifik træning. Corti Symphony opnår eksempelvis 25% højere præcision end generiske modeller i medicinsk kodning, hvilket direkte reducerer risikoen for kritiske fejl.

Skal jeg vælge proprietær, open source eller hybrid løsning?

En hybrid model anbefales til opgaver med høj volumen og høje sikkerhedskrav, da den kan kombinere proprietær compliance og fleksibilitet fra open source komponenter uden fuld vendor lock-in.

Hvordan sikrer jeg at AI-oversættelse er compliant under EU AI Act?

EU AI Act kræver robusthed og dokumenteret compliance for generelle AI-modeller. Vælg leverandører, der kan fremvise auditlogs, SLA-dokumentation og robusthedscertificeringer i overensstemmelse med EU-regulering.

Anbefaling