Hvad er LLM i sprogteknologi og hvordan sikrer de compliance

- 26. mar.

- 10 min læsning

Mange professionelle i regulerede brancher hører ofte om LLM, men få forstår præcist, hvad disse modeller gør, og hvorfor de er afgørende for sikker, compliant oversættelse. I modsætning til traditionel maskinoversættelse kan large language models forstå kontekst, følge terminologiske regler og levere præcise resultater i højrisikosektorer som life sciences, jura og finans. Denne artikel afklarer, hvad LLM er i sprogteknologi, hvordan de fungerer, og hvorfor de er uundværlige for virksomheder, der opererer under strenge regulatoriske krav som GDPR, HIPAA og EU AI Act.

Indholdsfortegnelse

Hvad er large language models og hvordan fungerer de i sprogteknologi

Anvendelser og grænser ved LLM i sprogteknologi for regulerede industrier

LLM i compliance og datasikkerhed for life sciences, jura og finans

Fremtid og bedste praksis for brug af LLM i regulerede brancher

Opdag hvordan AD VERBUM hjælper med AI-baseret og compliant oversættelse

Vigtigste Pointer

Punkt | Detaljer |

Domæne specifik finetuning | En generel LLM kan begå fejl i specialiserede domæner, mens en finetuning tilpasset branchens terminologi giver højere præcision. |

Overholdelse og regler | Overholdelse af GDPR, HIPAA og EU AI Act er afgørende for at sikre lovlig og sikker anvendelse af oversættelsesteknologi. |

Sikker oversættelse i højrisikosektorer | LLM gør det muligt at bevare præcision og terminologi i life sciences, jura og finans, hvor fejl kan have store konsekvenser. |

Udfordringer og begrænsninger | Hallucinationer og lange kontekstgrænser kræver løbende overvågning og kvalitetskontrol for at opretholde sikker compliance. |

Nøglepunkter

Indsigt | Detalje |

LLM definition | AI-modeller trænet på enorme tekstmængder til at forstå og generere naturligt sprog |

Værdi for regulerede industrier | Fine-tuned LLM sikrer compliant, sikre oversættelser med terminologisk præcision |

Udfordringer | Hallucinationer, bias og lang-kontekst begrænsninger kræver omhyggelig styring |

Frontier vs fine-tuned | Frontier LLM klarer zero-shot opgaver, men fine-tuned modeller giver højere præcision |

Compliance | Overholdelse af EU AI Act og datasikkerhedsstandarder er kritisk for lovlig anvendelse |

Hvad er large language models og hvordan fungerer de i sprogteknologi

Large Language Models (LLM) repræsenterer et fundamentalt spring i AI-drevet sprogbehandling. LLM står for Large Language Model, avancerede AI-modeller der forstår, genererer og behandler naturligt sprog baseret på transformer-arkitektur. Disse systemer adskiller sig fra ældre teknologier ved deres evne til at håndtere komplekse, kontekstafhængige sprogopgaver med bemærkelsesværdig præcision.

I kernen anvender LLM transformer-arkitektur, en neural netværksstruktur introduceret i 2017, der bruger self-attention mekanismer til at veje hvert ords betydning i forhold til alle andre ord i en sætning. Dette gør det muligt for modellen at forstå nuancer som negationer, idiomer og domænespecifik terminologi. Parametre, målt i milliarder, definerer modellens kapacitet: jo flere parametre, desto mere komplekse mønstre kan den lære.

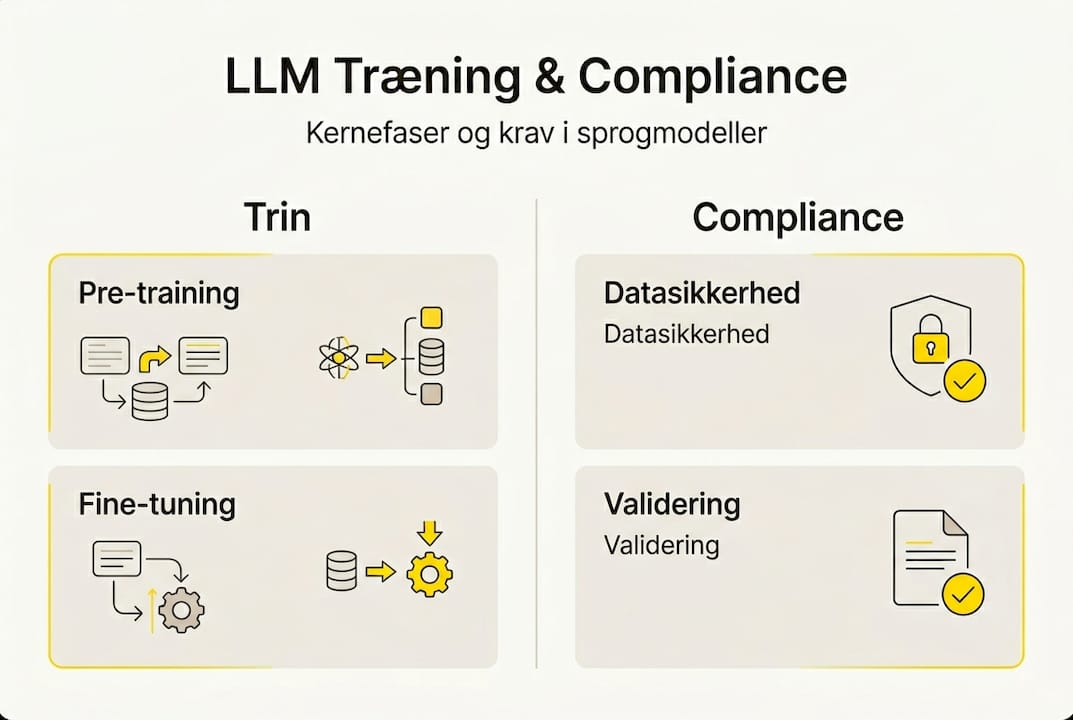

Træning sker via pre-training og fine-tuning med milliarder af parametre og selv-overvåget læring. Pre-training involverer at fodre modellen med massive tekstkorpora fra internettet, bøger og videnskabelige artikler, hvor den lærer at forudsige næste token (ord eller subord). Fine-tuning tilpasser derefter modellen til specifikke domæner som medicinsk dokumentation eller juridiske kontrakter ved at træne den på branchespecifikke datasæt.

Tokenisering opdeler tekst i håndterbare enheder. For eksempel bliver “oversættelse” opdelt i tokens som “over”, “sætt” og “else”, hvilket gør det muligt for modellen at håndtere sjældne eller sammensatte ord. Self-attention vægtning betyder, at når modellen ser “device” i en medicinsk kontekst, forstår den automatisk, at det refererer til et medicinsk apparat, ikke en generisk genstand.

Professionelt tip: For domænespecifikke opgaver i regulerede brancher er fine-tuning ikke valgfri, det er obligatorisk. En generel LLM kan fejloversætte “non-toxic” til “toxic” ved at udelade negationen, mens en fine-tuned model trænet på farmaceutisk terminologi aldrig begår denne fatale fejl. Invester i oversættelsesteknologi for compliance, der anvender domænetilpassede LLM.

Vigtige træk ved LLM i sprogteknologi:

Next-token prediction som kernetræningsmetode, der lærer kontekstuelle sammenhænge

Emergent abilities, hvor modeller spontant udvikler evner som matematisk ræsonnering ved øget skala

Zero-shot og few-shot learning, der gør det muligt at udføre opgaver uden eksplicit træning

Multimodal kapacitet i nyere modeller, der kombinerer tekst, billeder og strukturerede data

Trin for trin forståelse af LLM funktionalitet:

Input tokenisering: Teksten opdeles i tokens, der repræsenteres som numeriske vektorer

Self-attention processing: Modellen evaluerer hvert tokens relation til alle andre for at forstå kontekst

Layer stacking: Hundredvis af transformer-lag bearbejder informationen, hvor hvert lag forfiner forståelsen

Output generation: Modellen forudsiger næste token baseret på sandsynlighed, gentaget indtil en komplet sætning dannes

Post-processing: Resultatet dekodes fra tokens tilbage til læsbar tekst

Anvendelser og grænser ved LLM i sprogteknologi for regulerede industrier

LLM bruges til oversættelse, opsummering, sentiment-analyse og spørgsmål-svar i sprogteknologi. I regulerede sektorer som life sciences, jura og finans er præcision ikke bare ønskelig, den er lovpligtig. En fejloversættelse i en klinisk prøveprotokol kan forsinke godkendelser med måneder og koste millioner. En unøjagtig juridisk kontrakt kan ugyldiggøre hele aftaler.

Kerneanvendelser i sprogteknologi omfatter:

Oversættelse: Kontekstbevidst konvertering mellem sprog med terminologisk konsistens

Opsummering: Kondensering af lange dokumenter til præcise resuméer uden tab af kritisk information

Question Answering: Udtrækning af specifikke svar fra komplekse dokumentsamlinger

Sentiment-analyse: Identifikation af tone og holdning i kundefeedback eller juridiske indlæg

Named Entity Recognition: Automatisk identifikation af personer, organisationer, datoer og dosisoplysninger

Benchmarks viser SoTA på multilingual tasks, men lang-kontekst har begrænsninger, mens hallucinationer og bias forekommer. State-of-the-art modeller som GPT-4 og Claude opnår imponerende resultater på standardbenchmarks, men disse tests afslører sjældent edge cases, der er kritiske i regulerede miljøer.

Dokumenterede begrænsninger inkluderer:

Hallucinationer: Modellen genererer plausibelt klingende, men faktisk forkert information, især ved komplekse tekniske termer

Bias: Træningsdata afspejler samfundsmæssige skævheder, hvilket kan føre til diskriminerende output i HR-dokumenter eller patientinformation

Long-context degradation: Præcision falder markant, når dokumenter overstiger 8.000-16.000 tokens, problematisk for lange kontrakter eller kliniske rapporter

Terminologisk inkonsistens: Uden streng styring kan samme term oversættes forskelligt gennem et dokument

Model type | Præcision | Compliance | Datasikkerhed | Anvendelse |

Offentlig NMT | Moderat | Lav | Kritisk risiko | Generel tekst |

Frontier LLM | Høj (zero-shot) | Moderat | Risiko ved cloud | Bred anvendelse |

Fine-tuned LLM | Meget høj | Høj | Kontrollerbar | Regulerede brancher |

Proprietær on-prem | Maksimal | Maksimal | Ingen risiko | Mission-critical |

Professionelt tip: I juridiske oversættelser er hallucinationer eksistentielle risici. En LLM kan indsætte klausuler, der aldrig eksisterede i kildeteksten, eller udelade afgørende betingelser. Implementer altid sikrede oversættelsesmetoder, der kombinerer LLM output med ekspertvalidering fra jurister, der behersker både kilde- og målsprog.

Sammenligning af state-of-the-art modeller versus specialiserede løsninger afslører, at generelle LLM klarer sig godt på brede opgaver, men fejler konsekvent på domænespecifikke nuancer. En model trænet på internetdata kender måske ikke forskellen mellem “device” som medicinsk apparat og “device” som juridisk konstruktion. En fine-tuned model til medical device regulation kender denne distinktion implicit.

LLM i compliance og datasikkerhed for life sciences, jura og finans

LLM gør præcis AI-oversættelse mulig men kræver fine-tuning og overholdelse af EU AI Act for robusthed og fairness. Regulerede industrier opererer under strenge juridiske rammer, hvor selv mindre afvigelser kan udløse bøder, erstatningskrav eller tab af licenser. EU AI Act klassificerer højrisiko AI-systemer, herunder dem brugt i sundhedspleje og kritisk infrastruktur, og kræver dokumenteret compliance.

Fine-tuned LLM leverer den nødvendige præcision ved at specialisere sig i specifikke domæner. I life sciences betyder det træning på millioner af farmaceutiske dokumenter, kliniske protokoller og regulatoriske indberetninger. Modellen lærer, at “adverse event” altid skal oversættes til den godkendte ækvivalent i målsproget, ikke en synonym variation.

Benchmarks som PhT-LM viser stærke resultater i pharma og jura, men domain-specifik terminologi kræver specialisering. PharmacyTranslation Language Model opnår 94% terminologisk nøjagtighed på farmaceutiske oversættelser, sammenlignet med 76% for generelle modeller. I juridiske kontrakter er forskellen endnu mere udtalt: specialiserede modeller identificerer og bevarer juridiske konstruktioner, som generelle modeller ofte omskriver eller forenkler.

Critical compliance krav omfatter:

Fairness: Modellen må ikke diskriminere baseret på køn, alder eller etnicitet i HR-dokumenter eller patientinformation

Robustness: Output skal være stabilt og reproducerbart, selv ved små variationer i input

Transparency: Beslutningsprocessen skal kunne forklares og auditeres

Data minimization: Kun nødvendige data må behandles, i overensstemmelse med GDPR

Right to erasure: Træningsdata skal kunne slettes på anmodning

Datasikkerhedsstrategier for LLM i regulerede miljøer:

On-premises deployment: Host LLM på egne servere inden for EU-jurisdiktion for fuld datakontrol

Private cloud: Brug dedikerede cloud-instancer med kryptering og adgangskontrol

Open-source modeller: Implementer modeller som Llama eller Mistral, der kan køres lokalt uden vendor lock-in

Federated learning: Træn modeller på distribuerede datasæt uden at centralisere følsomme data

Differential privacy: Tilføj støj til træningsdata for at forhindre genkendelse af individuelle records

Branche | Compliance krav | LLM rolle | Kritisk risiko |

Life Sciences | GDPR, MDR, HIPAA | Oversættelse af kliniske data | Patientidentifikation |

Jura | Tavshedspligt, NDA | Kontraktoversættelse | Fortrolighedsbrud |

Finans | MiFID II, GDPR | Regulatorisk rapportering | Transaktionsdata lækage |

Trin for trin sikring af compliance i AI-baserede oversættelsesworkflow:

Data classification: Identificer følsomhedsniveau for alle dokumenter før LLM-behandling

Access control: Implementer rollebaseret adgang, så kun autoriseret personale kan behandle kritiske data

Audit logging: Log alle LLM-interaktioner med tidsstempler og bruger-ID for sporbarhed

Human validation: Kræv ekspertgennemgang af alt LLM-output før publicering eller indberetning

Continuous monitoring: Overvåg modelpræstation for drift og afvigelser, der kan indikere problemer

AD VERBUM’s proprietære LLM-baserede AI opererer udelukkende på EU-servere, hvilket eliminerer risikoen for dataudlevering til tredjelande. I modsætning til offentlige værktøjer som Google Translate eller ChatGPT, hvor input potentielt kan bruges til videre modeltræning, garanterer AD VERBUM’s closed-loop system, at din IP og patientdata aldrig forlader det sikre miljø. Dette er forskellen mellem compliance og katastrofe.

Fremtid og bedste praksis for brug af LLM i regulerede brancher

Frontier modeller klarer zero-shot opgaver bedst, men fine-tuned modeller er mest præcise til specifikke domæner. Frontier LLM som GPT-4, Claude og Gemini demonstrerer imponerende generaliseringsevne og kan håndtere opgaver, de aldrig eksplicit er trænet til. For regulerede brancher er denne fleksibilitet både en styrke og en svaghed.

Zero-shot kapacitet betyder, at en frontier model kan oversætte et medicinsk dokument uden forudgående træning på medicinske tekster. Resultatet er ofte læsbart og kontekstuelt fornuftigt, men mangler den terminologiske præcision, som regulatorer kræver. En fine-tuned model trænet på 100.000 farmaceutiske dokumenter vil konsekvent anvende godkendte termer og undgå synonymer, der kan forvirre regulatoriske myndigheder.

Emergent abilities ved transformer-skala giver nye muligheder, men long-context degradation kræver hybridmetoder som RAG. Når LLM skaleres til hundredvis af milliarder parametre, udvikler de spontant evner som matematisk ræsonnering, kode-generering og multi-step planning. Disse emergent abilities er ikke programmeret, men opstår som biprodukt af skala.

Long-context degradation udgør dog en vedvarende udfordring. Selv modeller med 128.000 token context windows viser faldende præcision, når kritisk information er begravet midt i lange dokumenter. Retrieval-Augmented Generation (RAG) adresserer dette ved at opdele dokumenter i segmenter, hente relevante sektioner baseret på forespørgslen og fodre kun disse til LLM. Dette reducerer kontekstlængde og forbedrer fokus.

Anbefalinger til optimal LLM-brug i regulerede miljøer:

Hybrid tilgang: Kombiner frontier modeller til bred forståelse med fine-tuned modeller til terminologisk præcision

RAG implementation: Brug retrieval systemer til at håndtere dokumenter over 10.000 ord effektivt

Ensemble methods: Kør multiple modeller parallelt og sammenlign output for at identificere uoverensstemmelser

Continuous fine-tuning: Opdater modeller kvartalsvis med nye regulatoriske guidelines og godkendte termer

Red teaming: Test modeller systematisk med adversarial inputs for at afsløre svagheder før deployment

Tilgang | Fordele | Begrænsninger | Bedst til |

Frontier LLM | Bred viden, zero-shot | Terminologisk drift | Eksplorativ analyse |

Fine-tuned | Høj præcision | Kræver træningsdata | Mission-critical oversættelse |

RAG hybrid | Lang-kontekst håndtering | Kompleks infrastruktur | Store dokumentsamlinger |

Best practice liste for compliance, sikkerhed og håndtering af edge cases:

Establish terminology governance: Oprethold centraliserede termbaser med godkendte oversættelser og forbyd afvigelser

Implement validation gates: Kræv menneskelig ekspertgodkendelse ved høj-risiko indhold som doseringsoplysninger eller juridiske forpligtelser

Monitor for model drift: Track modelpræstation over tid og retræn ved faldende accuracy

Document AI decisions: Gem alle LLM-genererede output med metadata for audit trails

Plan for model obsolescence: Forbered migrationsstrategier, når leverandører discontinuer modeller eller ændrer pricing

Test edge cases systematisk: Opbyg test suites med sjældne termer, negationer og komplekse syntaktiske strukturer

Maintain human expertise: Invester i lingvister med domæneviden, da AI aldrig kan erstatte ekspertkritisk tænkning fuldstændigt

Professionelt tip: Implementer løbende modelopdatering og menneskelig validering i alle workflows. Et dokument oversat i januar 2026 kan være forældet i marts, hvis regulatoriske termer ændres. AD VERBUM’s AI+HUMAN workflow sikrer, at både modeller og eksperter opdateres kontinuerligt, så dit output altid afspejler nyeste compliance-krav. Automatisering accelererer processen, men ekspertvalidering garanterer præcision.

Fremtidige trends peger mod multimodal LLM, der kombinerer tekst, billeder og strukturerede data. I life sciences kan dette betyde automatisk udtrækning af information fra scannede kliniske rapporter, hvor tekst, tabeller og grafer behandles simultant. For juridiske kontrakter kan modeller analysere både tekstklausuler og tilknyttede bilag for at identificere inkonsistenser.

Opdag hvordan AD VERBUM hjælper med AI-baseret og compliant oversættelse

Når præcision og compliance er ikke-forhandlingsbare, leverer AD VERBUM AI-drevne oversættelsesløsninger designet specifikt til regulerede brancher. Vores proprietære AI+HUMAN workflow kombinerer avanceret LLM-teknologi med ekspertvalidering fra 3.500+ fagspecialister, herunder læger, jurister og ingeniører.

I modsætning til offentlige værktøjer opererer AD VERBUM på en fuldt privat AI-infrastruktur hostet på EU-servere, hvilket garanterer GDPR, HIPAA og ISO 27001 compliance. Vores LLM er fine-tuned på millioner af domænespecifikke dokumenter inden for life sciences, jura og finans, hvilket sikrer terminologisk præcision, som generelle modeller ikke kan matche. Hver oversættelse gennemgår obligatorisk ekspertgennemgang, hvor fagspecialister verificerer teknisk nøjagtighed, regulatorisk overholdelse og kontekstuel nuance. Denne dobbelte sikring eliminerer risikoen for hallucinationer, terminologisk drift og compliance-brud. Udforsk vores professionelle oversættelsestjenester, lær mere om vores tilgang til oversættelse, eller se hvordan vi betjener oversættelse til regulerede brancher. Kontakt AD VERBUM i dag for at optimere dine oversættelsesprocesser med sikkerhed og præcision.

Hvad er LLM i sprogteknologi - ofte stillede spørgsmål

Hvad adskiller LLM fra andre AI-modeller i sprogteknologi?

LLM anvender transformer-arkitektur med self-attention mekanismer, der gør det muligt at forstå kontekst på tværs af hele dokumenter, ikke kun isolerede sætninger. I modsætning til ældre Neural Machine Translation (NMT) kan LLM følge instruktioner som “brug altid term X for koncept Y” og tilpasse output til specifikke stilguides. Denne kontekstbevidsthed og instruktionsfølsomhed gør LLM overlegne til komplekse, regulerede oversættelsesopgaver.

Hvordan sikrer man, at LLM-baserede oversættelser er compliant?

Compliance kræver en kombination af fine-tuning på domænespecifikke data, streng terminologisk styring via termbaser og obligatorisk menneskelig ekspertvalidering. Implementer audit logging af alle LLM-output, test systematisk for edge cases og opdater modeller kvartalsvis med nye regulatoriske guidelines. Brug kun on-premises eller private cloud deployment for at undgå datalækage. Læs mere om oversættelseskompliance for detaljerede strategier.

Hvilke er de største risici ved brug af LLM i juridiske oversættelser?

Hallucinationer udgør den primære risiko, hvor LLM kan indsætte klausuler eller udelade betingelser, der aldrig eksisterede i kildeteksten. Terminologisk inkonsistens kan føre til juridisk tvetydighed, hvor samme koncept oversættes forskelligt gennem dokumentet. Dataudlevering til offentlige LLM-tjenester kan bryde tavshedspligt og NDA-aftaler. Implementer altid AI+HUMAN workflows med jurist-validering og brug proprietære, on-premises LLM for følsomme kontrakter.

Kan LLM håndtere komplekse domain-specifikke termer i life sciences?

Ja, men kun med korrekt fine-tuning. Generelle LLM fejler konsekvent på farmaceutisk nomenklatur, lægemiddeldosering og klinisk terminologi. Fine-tuned modeller trænet på hundredtusindvis af medicinske dokumenter opnår 94%+ terminologisk nøjagtighed ved at lære godkendte oversættelser for hver term. Kombiner dette med integrerede termbaser og ekspertvalidering fra lingvister med medicinsk baggrund for maksimal præcision. Se hvordan datasikker oversættelse håndterer disse udfordringer.

Hvordan kombineres AI og menneskelig ekspertise for maksimal sikkerhed?

Optimal sikkerhed opnås gennem en AI+HUMAN workflow, hvor LLM genererer første udkast baseret på fine-tuned modeller og integrerede termbaser, efterfulgt af obligatorisk gennemgang fra fagspecialister med både sproglig og domæneviden. Eksperten verificerer terminologisk præcision, identificerer hallucinationer, sikrer regulatorisk compliance og validerer kontekstuel nuance. Denne dobbelte proces kombinerer AI’s hastighed med menneskelig kritisk tænkning, hvilket eliminerer risici ved ren automatisering og samtidig accelererer levering sammenlignet med manuel oversættelse.

Anbefaling